Нравится вам это или нет, мы можем ожидать, что генеративный ИИ будет вторгаться в нашу повседневную жизнь в обозримом будущем. Никто еще не зарабатывает на технологии, и большая часть этого явно не готова к прайм -тайм, но с момента запуска CHATGPT в ноябре 2022 года это был джаггернаут, который полностью отравил общественный дискурс.

В современном мире обычный человек уже слишком сразу же поверит, что последнее, что он читает или слышит. Теперь пользователи могут собрать вместе тревожные фотореалистические изображения и видео, или даже клоны ИИ чьего -либо голоса, используя в основном автоматизированные инструменты, которые часто доступны бесплатно или низкими ценами, если есть платный завод. В то время, когда наши телефоны постоянно завалены мошенническими телефонными звонками, которые добывают пожилых людей, эта новая технология означает, что становятся еще проще для мошенничества. Как вы думаете, ваши бабушка и дедушка могут сказать, не был ли клон вашего голоса?

Текст, сгенерированный AI, имеет разные проблемы, так как потенциальный элемент хитрости не так присутствует, но они, тем не менее, значительны. Большие языковые модели (LLMS), которые лежат в основе чат -ботов, таких как CHATGPT, склонны к «галлюцинации» полной чепухи независимо от того, насколько конкретным является подсказка, что приводит к тому, что AI ужасные истории, такие как изобретательные детали LLM в судебном суде, попросили подвести итог. К счастью, есть способы обнаружить текст, сгенерированный AI, в том числе бесплатные инструменты, поэтому давайте рассмотрим некоторые из них.

Инструменты обнаружения текста, сгенерированные AI

Самый простой способ обнаружить текст, сгенерированный AI,-это использовать один из различных веб-инструментов, которые были разработаны для его обнаружения. Они не идеальны: эти инструменты могут иметь ложные срабатывания, а также могут легко пометить текст, который проходил через вспомогательные инструменты искусственного интеллекта-например, грамматические и другие, которые помогают авторам самооценку их работы-как полностью создавались генеративными инструментами искусственного интеллекта, такими как CHATGPT Полем Так что иногда они недостаточно хороши, в то время как в других случаях они, возможно, слишком хороши. Эти инструменты используют предсказуемость LLMS на основе их обучающих данных, чтобы попытаться выяснить, является ли текст генерируется AI, что означает, что он в основном смотрит на текст с лингвистической точки зрения. В результате, детекторы ИИ могут пропустить другие явные знаки, такие как вопиющие фактические проблемы, которые ожидают, что человек или редактор человека или редактор.

Список инструментов обнаружения искусственного интеллекта, которые получили значительное внимание, включает в себя Gptzero, создание специалиста по информатике Принстонского университета Эдварда Тянь. Сначала его точность была поражена или пропустила, но она улучшилась во времени. Grammarly, помощник по редактированию копии, созданный AI, также имеет собственное приложение для обнаружения искусственного интеллекта. Это может быть поражен или пропустить, особенно с помощью более коротких блоков текста, но с тем, что важно проверить подлинность, среднее значение ватина в порядке. В частности, Gptzero предлагает более детальный анализ, например, выявление «словарного запаса AI», который обычно появляется в тексте, сгенерированном AI.

Полная неспособность понять контекст

В следующий раз, когда вы прочитаете статью на веб -сайте, которая не совсем выше доски или установленного веб -сайта, на котором, как известно, использовал генеративный ИИ для написания статьи, спросите себя: это читает так, как есть ошибки, которые человек не сделал бы ? Существуют ли утверждения или последствия, которые не связаны с нашей установленной реальностью? Может быть, даты, которые не имеют смысла относительно возраста людей, о которых писают? Это еще один признак того, что вы читаете статью, сгенерированную AI. Наиболее запоминающимися и громкими примерами того, как Genai не может различить контекст, вероятно, были бы наиболее смущающими примерами «Обзор искусственного интеллекта», что приведет к поиску Google после того, как продукт был запущен в 2024 году.

ИИ Google не мог различить юмор или сарказм, даже во время взвешивания информации из менее чем авторитетных источников, таких как комментарии Reddit, или копированная статья с лука, что приводит к таким ситуациям, как обзор искусственного интеллекта, предполагая, что вы используете клей, чтобы не допустить сыра. Или есть камни для пищевых преимуществ. Даже с более авторитетными источниками он не мог понять, что издательство из прессы Оксфордского университета, имеющая главу под названием «Барак Хуссейн Обама: первый президент мусульман Америки?» А президент Обама не принадлежит к конкретной христианской религиозной конфессии, не означал, что Обама на самом деле был мусульманином. Если вы прочитали очень странно написанную статью и чувствуете, что ни один человек не мог бы автоформировать ее, то ваши инстинкты, вероятно, верны.

Чрезмерно настойчивый словарь с использованием общих слов ИИ

Другим контрольным признаком Genai в тексте является то, что у крупных языковых моделей есть привычка иметь любимые слова и фразы, которые они используют снова и снова. В другое время это могло рассматриваться просто как чрезмерно цветочное письмо. Теперь это часто может помочь определить, написал ли бот что -то. Когда дело доходит до конференц -фраз Genai, ученый -данные Муртаза Хайдер полезно разбил их на семь категорий в блоге в августе 2024 года: ВВЕДЕНИЯ, и повторяющиеся или запасы.

Если вы прочитаете статью, в которой есть много фраз, которые чувствуют, что они получили бы вам плохую оценку в эссе средней школы, то существует довольно высокая вероятность того, что она была написана Genai. «В заключение», например, является общим контекстуальным соединителем ИИ, в то время как примеры выраженных фраз для неопределенности или обобщения имеют четкую линию, соединяющую их. «Важно отметить, что« можно утверждать, что »,« широко признано, что »,« есть доказательства, которые следует предположить »и« во многих случаях » — все это примеры фраз, которые, кажется, используют Genai особенно часто. Как правило, если вы видите статью на сомнительном сайте с большим количеством прокладки, которая кажется очень неестественной, вы должны учитывать, что она была написана Genai.

Исследование автора вызывает красные флаги

Еще один способ различить, если статья была написана генеративным ИИ, — это расследование автора. У некоторых сайтов есть более вопиющие рассказы; Например, CNET не назначает человеку, сгенерированным AI статьи, просто такую линию, как «написано CNET Money», когда редактор человека получает «отредактированный» кредитом. Другие сайты даже не такие прозрачные. В ноябре 2023 года футуризм сломал историю о том, что Sports Illustrated использовал генеративный ИИ для написания статьи, приписываемых фальшивым писателям. Статья футуризма служит планом для того, как расследовать происхождение автора: она открывается рассказом о «Дрю Ортисе», авторе, у которого нет присутствия в Интернете за пределами SportsIllustrated.com и фотография, доступная для продажи на генерируемых. Photos,, Веб-сайт, который продает сгенерированные AI выстрелы в голову.

«Работа» «Дрю Ортиса» также была довольно явно сгенерированной AI. «Волейбол может быть немного сложным, особенно без настоящего мяча для практики», — начинает один любопытный отрывок. «Вам придется бурить в основе в своей голове, прежде чем вы сможете играть в игру так, как она должна была быть сыграна, и для этого вам понадобится специальное место для практики и полноразмерный волейбол». Материнская компания, группа Arena, подтвердила футуризму, что содержание было от подрядчика, Advon Commerce, который использовал Genai. Теперь, когда дверь была открыта, это привело к увеличению скептицизма новых авторов на других веб -сайтах, особенно после приобретения сайта.

Это становится неверным, так как люди никогда не будут

Другим способом определения сгенерированной AI кусок «письма» является изучение фактических утверждений, сделанных. Даже если вы не знаете правду по этому поводу с макушки головы, утверждения факта в данной статье все равно могут быть настолько надуманными, что на его лице очевидно, что ни один человек -писатель с ликом смысла или профессионал мог бы написать их.

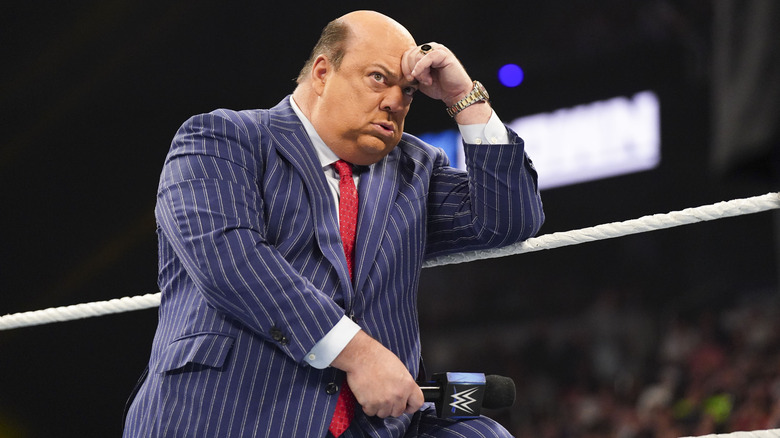

Несмотря на то, что никогда не подтверждается, что он создан Generative AI, один из примеров, который выпрыгивает, — это статья, опубликованная Sportskeeda в марте 2024 года, а затем удален после тщательного изучения в Интернете. Это оптимизированная поисковая работа, которая стремится привлечь читателей, ищущих информацию о семейном положении личности профессиональной борьбы Пола Хеймана, который долго держал ту сторону своей жизни-его детей, его бывшей жены и его развода-частного. «Говоря о бывшей жене Пола Хеймана, согласно Celecrystal.com, Марла Хейман родилась в 1991 году»,-гласит один отрывок, в то время как другой заявляет, что «они приветствовали своего первого ребенка, дочь по имени Азалея в 2002 году и сын по имени Джейкоб в 2004 году » Поскольку Sportskeeda, несомненно, не пыталась обвинить Павла в чем -то сомнительном, стало очевидно, что человеческое письмо, статья, была невероятно маловероятно.

Это просто здравый смысл: ни один рациональный человек не будет писать, что у общественного деятеля был ребенок с 11-летней девочкой таким образом. Только Генай объясняет эту статью.