Нельзя отрицать влияние, которое ИИ уже оказал на технологии, которые мы используем каждый день. Большая часть оппозиции вокруг его появления сосредоточена вокруг того, где и как он используется. Возможно, вы не знаете о многих различных способах, которыми ВВС США уже используют ИИ, но его возможности повышения эффективности и упрощения логистики огромны. Однако очень важно действовать осторожно при интеграции ИИ в военные дела. Закон об AI Guardrails, представленный сенатором от штата Мичиган Элиссой Слоткин в марте 2026 года, призван обеспечить именно то, что следует из названия: преобладающее человеческое влияние и окончательное решение, лежащее в основе работы ИИ.

Как подробно описано в правительственном пресс-релизе, сенатор Слоткин объяснила, что предлагаемый ею законопроект будет сосредоточен на трех ключевых областях: «обеспечить участие человека в стрельбе из смертоносного автономного оружия, невозможность использования искусственного интеллекта для шпионажа за американским народом и то, что человек находится в состоянии запуска ядерного оружия». Эти меры направлены не на то, чтобы ограничить развитие индустрии ИИ в США, а, скорее, на защиту доминирования страны в этой области («мы должны выиграть гонку ИИ против Китая», — добавил депутат из Мичигана), одновременно гарантируя, что она развивается безопасным и практичным способом.

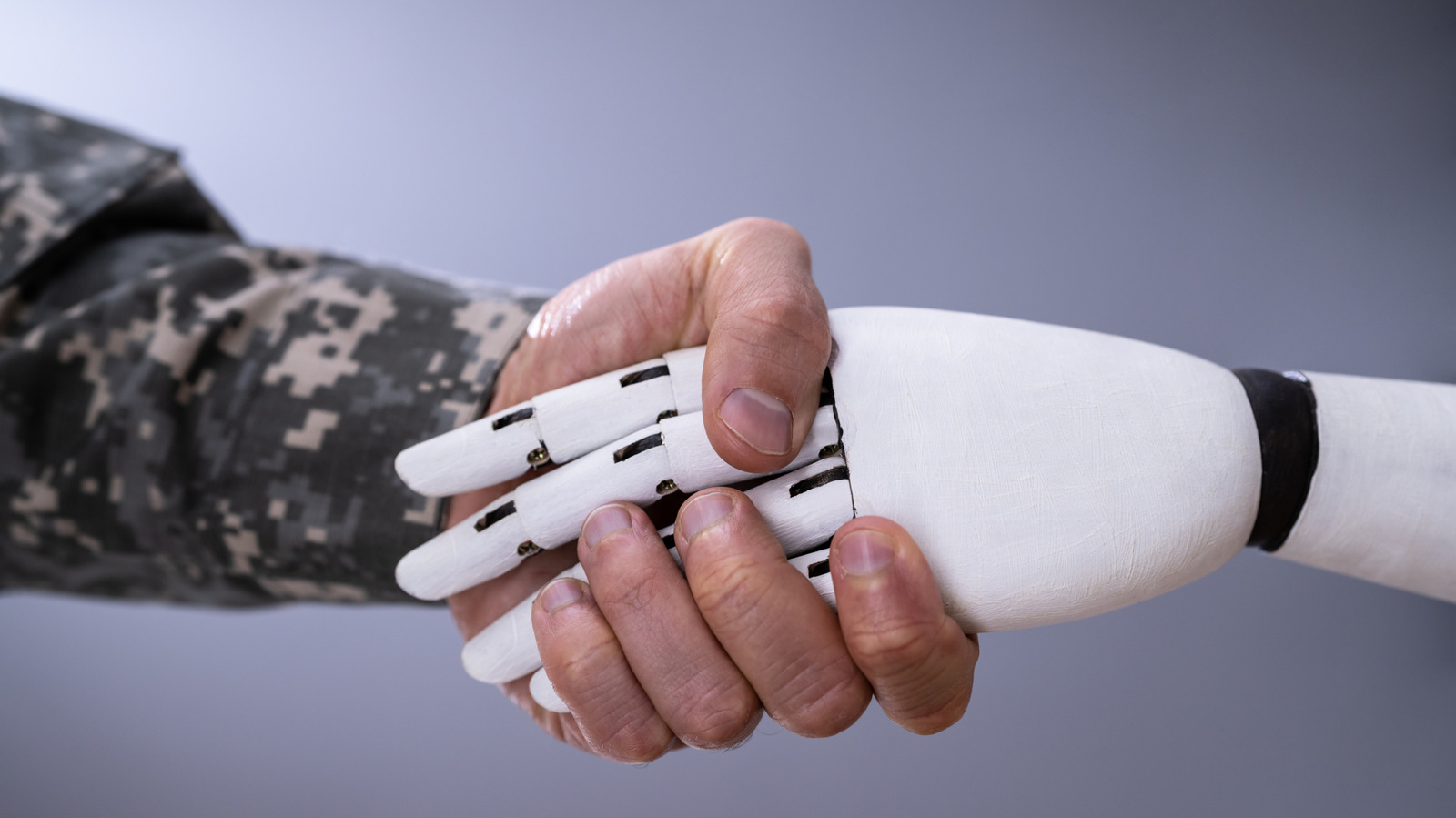

Ведь сбои, сбои и ошибки – далеко не редкость в сфере ИИ. Человеческое суждение и процесс принятия решений, конечно, тоже не являются непогрешимыми, но лучший способ получить выгоду от того и другого — использовать их в тандеме. Вот как законопроект может помочь Соединенным Штатам в этом.

Более подробная информация о Законе об AI Guardrails Act

В пресс-релизе, подробно описывающем меры, включенные в закон об AI Guardrails, сенатор Слоткин заявляет, что ограничение способности технологии наносить удары с помощью автономного оружия без надзора, запрет на запуск ядерного оружия и предотвращение ее использования для повсеместного наблюдения за населением являются «просто здравым смыслом». Вполне понятно, что это не новые концепции. Например, в Директиве Министерства обороны 3000.09 отмечается, что вооружение должно создаваться с учетом концепции, «позволяющей командирам и операторам проявлять соответствующий уровень человеческого суждения по поводу применения силы». Частично именно поэтому некоторые системы вооружения с автоматизированными возможностями, такие как Phalanx CIWS ВМФ, также будут иметь режимы, которые «указывают» цели, но требуют разрешения на стрельбу по ним, а также автоматические режимы (если они включены).

Короче говоря, цель этого законопроекта состоит в том, чтобы сделать эти три потенциальных варианта использования ИИ незаконными. Что касается причин, в самом документе просто объясняется: «Некоторые решения военного командования слишком рискованны и слишком значимы для машин». Это также помогает обеспечить ответственность и подотчетность за каждое принятое военное решение, но ситуация может стать довольно мутной, когда система ИИ действует более независимо.

Этот шаг можно рассматривать как интересное развитие пяти принципов этического искусственного интеллекта, которые были приняты во внимание в рамках стратегии развития ИИ департамента в феврале 2020 года. Они заявляют, что использование ИИ должно быть справедливым, управляемым, надежным, ответственным и отслеживаемым. Поскольку на момент написания законопроект был новым в повестке дня, еще неизвестно, как он отреагирует на коллег-законодателей сенатора от Мичигана. Это может стать важным шагом к безопасному управлению развитием ИИ в одной из наиболее потенциально опасных областей.